Стратегический гений природы: почему олени не бьются насмерть?

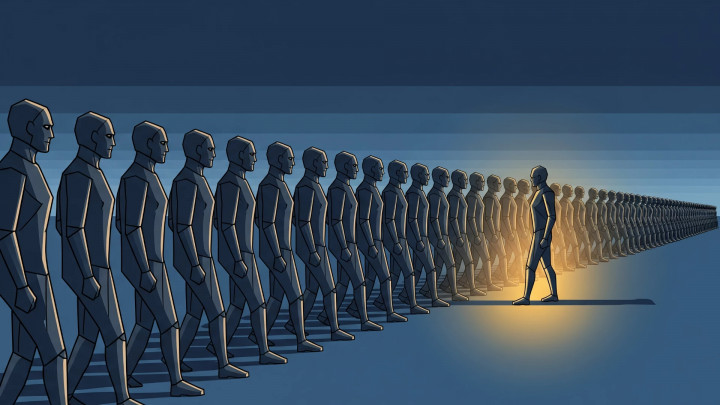

В осеннем лесу два огромных благородных оленя сходятся в поединке. Они сцепляются рогами, демонстрируют силу и громко ревут. Поединок выглядит зрелищно и жестоко, но в большинстве случаев более слабое животное в конце концов сдаётся и отступает, позволяя победителю завоевать расположение самок. Такие поединки редко заканчиваются смертью. Но почему? Это, кажется, не соответствует классическому образу «природы в крови и когтях» — кровавой борьбы за выживание. Если конечная цель — передать свои гены, почему проигравший не пытается победить любой ценой, даже рискуя жизнью?